Depuis quelques années, le concept d’attention est au centre de toutes les attentions. Certains y voient même le Graal qui va sauver le marché de la fin des cookies ! N’exagérons pas, mais le fait est que c’est une notion importante.

Importante, mais encore floue, car d’une part l’attention n’est pas définie officiellement (comme peut l’être la visibilité), et car d’autre part elle met en jeu des concepts cognitifs complexes. Pourra-t-elle donc être définie précisément un jour ?

La méthode la plus précise et sérieuse pour mesurer l’attention, c’est l’eye tracking. Avec des dispositifs techniques on suit le déplacement du regard sur un écran (ou même hors de l’écran). Selon que le dispositif de mesure est des lunettes (chères) ou une webcam, on obtient des niveaux de précision différents.

Dans les deux cas, la mesure met en jeu un échantillon de volontaires (panel) qui se prête au jeu. Heureusement, personne de sérieux à ma connaissance n’est venu pirater les webcam pour mesurer l’attention…

Cette méthode est donc coûteuse, et peu d’environnements peuvent être mesurés précisément.

Les outils de mesure de l’attention créent donc des méthodes hybrides, qui mélangent différentes sources de données.

On dispose de trois sources de données dans le monde de la publicité digitale :

- user-centric : du point de vue de l’individu

- site-centric : du point de vue du site

- banner-centric : du point de vue de la bannière publicitaire.

L’eye-tracking est purement user-centric (je fais ce que je peux pour limiter les anglicismes, promis !). Mais un panel, dont l’activité est mesurée est aussi user-centric.

Les données site-centric sont souvent récoltées par des robots, qui analysent le contenu des pages. De tels robots peuvent détecter les publicités, leur nombre, leurs formats, leurs positions et fournir des informations intéressantes.

Les données banner-centric sont classiques dans la publicité : la visibilité est un pur exemple de mesure banner-centric. Un script embarqué dans la publicité mesure la visibilité dans son contexte de diffusion.

Site-centric et banner-centric présentent l’énorme avantage d’une presque exhaustivité. On arrive maintenant à mesurer la visibilité de toutes les impressions publicitaires, et à analyser presque tous les sites.

Des modèles peuvent être créés pour combiner ces différentes données et estimer une attention qu’il n’est pas possible de mesurer exhaustivement.

Implcit aussi combine des données user, banner et site-centric.

- user : le panel nous donne le temps passé sur chaque page. Et condition indispensable, le panel mesure si la cible cherchée a été atteinte.

- site : nos robots visitent les pages pour analyser les publicités qui s’y trouvent

- banner : nous collectons les données de visibilité et de complétion pour les vidéos

Par exemple, prenons deux pages :

- elles ont chacune 10 publicités (info site-centric fournies par les robots)

- le panel (user-centric) nous informe que les internautes passent en moyenne 5 minutes sur la première et 5 secondes sur la deuxième.

La qualité publicitaire des deux pages n’est pas la même. L’une exposera le visiteur à une publicité toutes les 30 secondes, l’autre à deux publicités par seconde !

Lorsque la campagne tourne, la visibilité et la complétion fournissent le troisième élément (banner-centric) qui permet d’estimer l’attention.

Je dis bien « estimer », car ce n’est pas à proprement parler une mesure, comme avec l’eye-tracking. Sans certitude d’attention, on est en capacité d’affirmer que la publicité a » probablement été diffusée dans des conditions propices à l’attention ».

Le tout est calculé avec les données mesurées sur les internautes qui font partie de la cible de la campagne. Cette information est aussi user-centric car fournie par le panel.

L’autre dimension de l’attention, c’est son activation. Mesurer c’est une chose, contrôler c’en est une autre. Et dans ce cas, on ne peut parler que d’estimations.

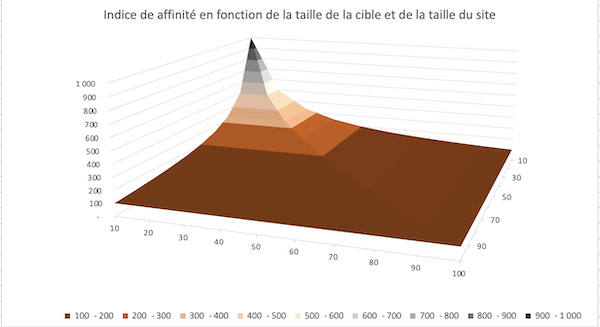

Il est possible de prévoir la visibilité et la complétion d’une publicité. En combinant ces deux prévisions banner-centric avec la qualité publicitaire (telle qu’on la mesure en site-centric et user-centric), on peut réunir les conditions qui, in fine, vont générer de l’attention.

Chercher les inventaires publicitaires de meilleure qualité, où les publicités sont visibles et où les vidéos sont diffusées complètement, c’est se mettre dans les meilleures conditions d’attention. Et alors, quelque soit la méthode utilisée pour la mesurer, l’attention sera maximale.