On ne parle que de ça depuis ce matin : Google annonce qu’ils laissent plus de temps à l’autorité de la concurrence anglaise (CMA) pour tester son alternative aux cookies tiers (Privacy Sandbox). Voir le court article de Google.

Google s’est déjà plusieurs fois déjugé en repoussant l’arrêt des cookies. Cette fois, ils utilisent la CMA pour partager la responsabilité. Ça se voit, mais là n’est pas le sujet…

Je ne peux pas m’empêcher de faire un parallèle avec la loi Hadopi de 2010. Cette loi visait à pénaliser les téléchargements illégaux (de musique essentiellement à l’époque). Il y a eu finalement assez peu d’amendes à payer, mais le bruit de la loi a eu plus d’effets que les sanctions. Grâce à Hadopi, on a commencé à parler de la rémunération des artistes. De nombreux jeunes ne s’étaient jamais posé la question, la loi a permis de les éduquer. Sans Hadopi, les plateformes de streaming légales se seraient-elles développées ?

Il y a donc un effet indirect des décisions publiques. Hadopi d’un côté, les cookies tiers de l’autre.

Depuis plus de 4 ans, le marché publicitaire internet vit dans l’incertitude : « comment ferons-nous lorsqu’il n’y aura plus de cookies ? ». Vraiment ? Vous pensez qu’on est restés à attendre dans le stress, avec fatalité ? D’ailleurs, dans fatalité, le « fa » vient de l’indo-européen qui signifie « la parole », fatalité, c’est la parole contre laquelle on ne peut rien, celle de Dieu. Google, un Dieu omniscient ?

Bref, le marché n’a pas attendu.

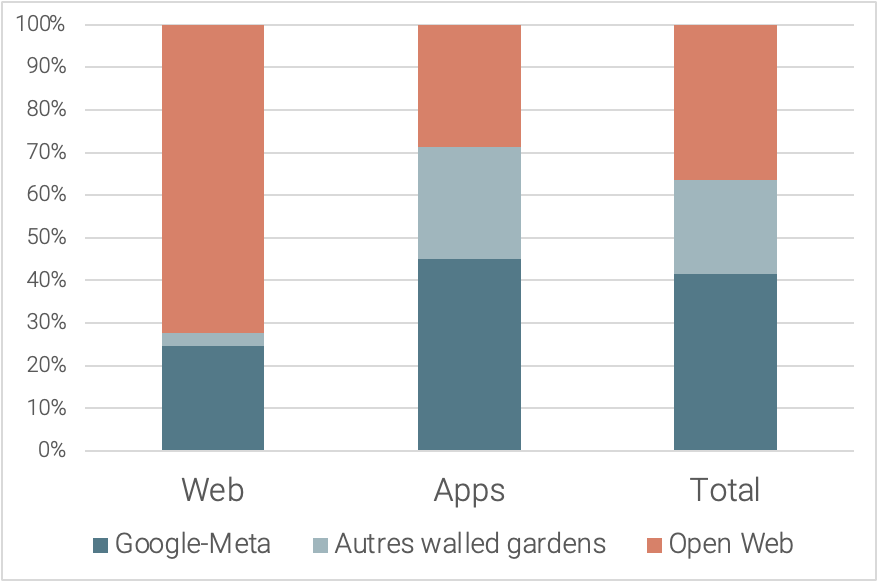

Déjà, Firefox et Safari avaient ouvert le robinet qui vide la baignoire (on parle de data pool) aux data. 40% des contacts publicitaires n’ont déjà plus de cookies tiers du fait de leur blocage par les navigateurs. Ajoutez le RGPD, vous ajoutiez encore 10% en 2022. La moitié des contacts publicitaires n’avaient déjà plus de data associées en 2022. Depuis, la baignoire continue de se vider. Certains annoncent même qu’elle est déjà vidée à 70% !

Mais surtout, le marché en a marre d’attendre la parole divine !

L’annonce de la fin des cookies a eu le même effet que la loi Hadopi. Tout le monde (les internautes lambda, les régies, les agences, les annonceurs) a pris conscience que la publicité utilise des data. Quiconque travaille dans la publicité digitale connaît des collègues qui utilisent des adblockers ! Schizophrénie ? Ou simple prise de conscience individuelle ?

Certains annonceurs, dans la grande consommation par exemple, renoncent à collecter des data sur leurs clients. Bon, d’accord, avec la vente indirecte, ils n’en avaient pas beaucoup. Mais au moins, ils peuvent communiquer sur le respect de la vie privée, et se poser en chevaliers blancs. C’est de bonne guerre…

Les agences ont une priorité : trouver où dépenser le budget que les annonceurs leur ont confié. Si elles se focalisaient sur les cookies tiers, tout leur budget serait concentré sur 30% des internautes ! Absurde, non ? Elles ont donc l’obligation de trouver des alternatives aux cookies tiers. Et, je le répète, pas sur Google et Meta !

Les régies voient fondre la valeur de leurs inventaires sans cookies tiers. Celles qui dépendent exclusivement de GAM (le serveur publicitaire de Google) ne peuvent même plus vendre les espaces publicitaires non consentis via GAM ! Pensez-vous que les régies ont renoncé à 70% de leurs inventaires publicitaires ?

Les internautes enfin, ont pris conscience du caractère intrusif de la publicité. Les taux de consentement baissent. Les sites doivent marchander pour obtenir le Graal du consentement : cookie wall (contenu inaccessible sans consentement), abonnement fictif (à un prix prohibitif)…

Mais le message est passé, les internautes veulent de la publicité ciblée, mais à la condition qu’ils ne s’en rendent pas compte !

C’est qu’en quatre ans, des solutions se sont développées. Certaines reproduisent les cookies tiers avec de nouvelles approches. D’autres partent d’un point de vue radicalement différent. C’est le cas d’Implcit, qui offre les mêmes capacités de ciblage que les data (socio-démographique, comportement, centres d’intérêts, intentions d’achats…) mais sur une couverture maximale. En effet, le ciblage contextuel n’a besoin ni de cookies ni de consentement.

L’annonce d’aujourd’hui sur les cookies tiers est donc un non-évènement.

Le marché a déjà tourné la page du cookie tiers. Certes, ils sont toujours utilisés, mais personne ne peut décemment fonder une stratégie publicitaire sur les cookies tiers.

Quelque soit la date réelle de la fin des cookies tiers, le mal est fait. Ils sont déjà cliniquement morts. Ne pratiquons pas l’acharnement thérapeutique sur les cookies tiers !

Chez Implcit, on ne parle même plus des cookies tiers…